修論進捗_250104

1. アプリ開発の進捗

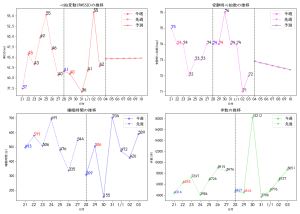

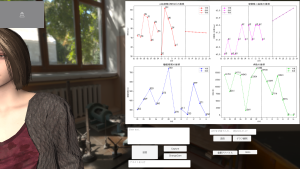

①Fitbitグラフ

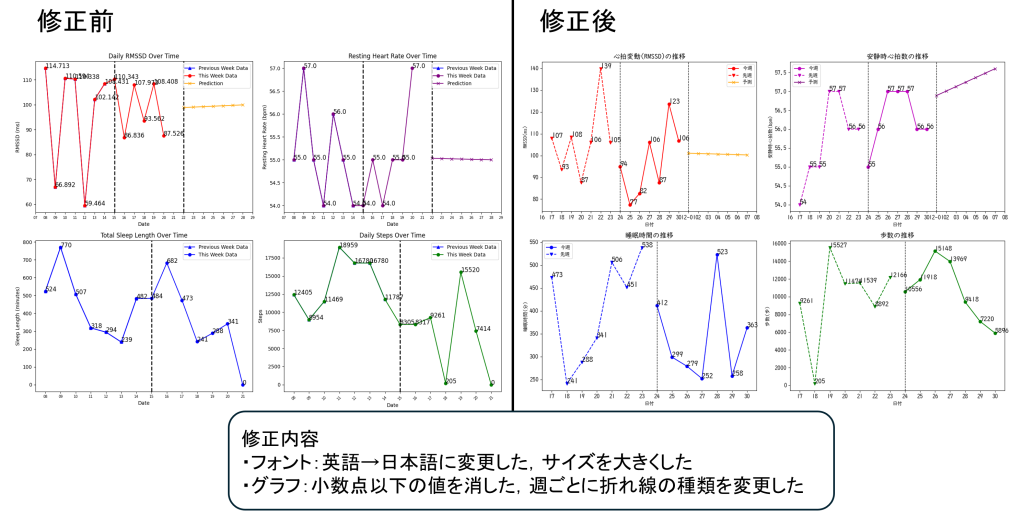

・色分け:GPTが認識しやすいように、グラフ内の数値を「土曜は青色、日曜は赤色」でそれぞれ示した。さらに、折れ線のマーカー色を薄く、月初めの日付をMM/DD形式にして、全体的に文字を大きくした。横軸の日付はうまくいかなかった。

・データ:前日までの2週間分のデータから,今日までの2週間分に変更

・ファイル名の変更:データを取得した日付を今日の日付にした

・睡眠時間の表記:MainLen→「MainLen+Awake」の算出方法に変更した.こちらの算出結果も同様に,csvファイルに保存済み.

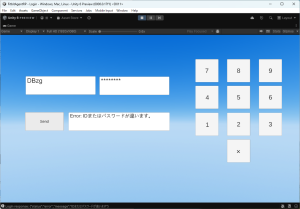

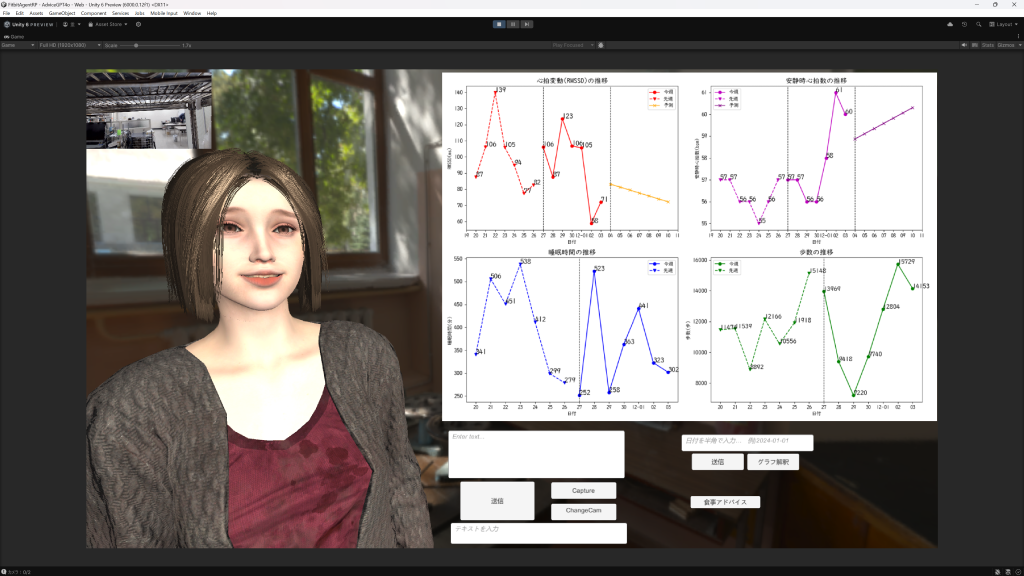

②Unityアプリ開発

・機能:過去データの閲覧機能を削除した

・環境音:軍人は焚火,世田谷女子は「生活音 or 屋外の音」で悩んでいる

・統制条件用:AIエージェントなし条件用にグラフのみを添付した

・ログイン画面:テンキー,自動変換を追加した,DBはcsv保存

・アドバイス文:厚生労働省(2023)を引用しアドバイス文の強化

2. 健康アプリの解説ブログ,インストラクション動画の作成

・実験全体の説明

・健康アプリのインストラクション動画の作成

・心理指標の回答タイミングなどなど

・↓運動や睡眠をどこまで提案してよいのか(提案はAIにやってもらう?)

=====================================================================

機能の追加候補

1. アプリ開発の提案で,前回のゼミで体調不良によるRMSSDの低下を,AIアドバイザーは単にストレスと判定していた。そのため,「今日の調子・忙しさを5段階で評定」を行い,Unityアプリか,毎日Formsの回答を行ってもらう。

→アドバイザーの評価の一参考になり,さらに参加者自身が自分の体調を気づくためのきっかけになる。

2. Fitbitデータの取得:取得できていない分をまとめて行う機能をつける

ランキングの話

・アドバイザーの有無だけでは有意差が出るか心配で,モチベーションが続くかも心配。一つの目標として,歩数のみを表示する。その際,個人情報の観点も配慮して,同意を得てニックネーム表示で行う。

実験参加者の方へ

この度は,研究にご協力いただきありがとうございます。本ブログでは,実験の流れと,Unityで開発した健康アプリの使用法についてご紹介いたします.健康アプリは,こちらのリンクをクリックすると確認できます.

1. 実験全体の流れ

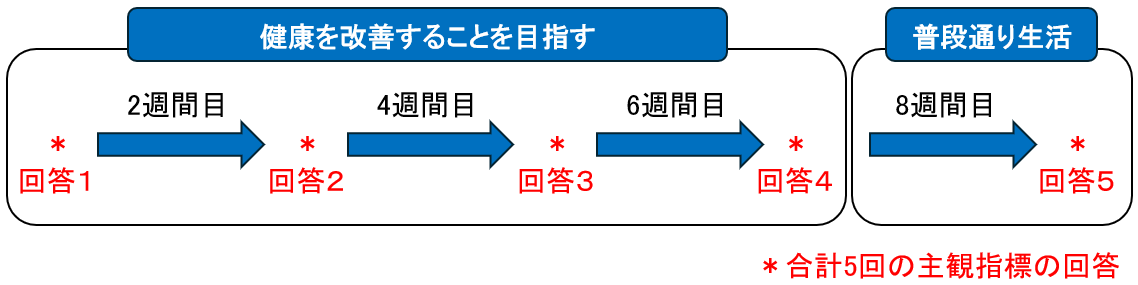

本実験は,8週間にわたり実施されます.最初の6週間は,AIアドバイザーのサポートを受けながら健康改善に取り組んでいただきます.最後の2週間はフォローアップとして,健康アプリを使用せず普段通りの生活を送っていただきます.なお,AIサポートあり期間では,健康に関する話題で積極的にAIと対話してください.

2. 実験期間中にやること

皆さんにやっていただくことは,フォローアップ期間を除く8週間の間に,「運動量・睡眠時間・心拍変動(RMSSD)の向上と,安静時心拍数を低下」を目指して健康を改善することです.具体的な実践方法については,実験者から指示を行うことはありません.各自で工夫しながら取り組み,AIアドバイザーの助言を参考にして進めてください.

*必ず1日1回のFitbitアプリの同期と,健康アプリの確認をお願いします!

3. 主観的指標の回答

主観的指標としては,GHQ30,日本語版QEWB尺度,三次元型睡眠尺度を用い,いずれも2週間おきに計5回の回答をしていただきます.GHQ30は紙媒体での調査となるため,実験開始前に配布した質問紙を使用し,その他質問紙はWebアンケートで実施します.さらに、開発したアプリの使用感に関する調査もWebアンケート形式で実施し、こちらは最終日に1回のみの回答となります。

*主観的指標の回答は,いずれもTeamsを通じて依頼します.なお,回答タイミングと回答用リンクについては,下記の表に示してあります.

| 1回目 ・回答リンク ・GHQ30は紙版 | 2回目 ・回答リンク ・GHQ30は紙版 | 3回目 ・回答リンク ・GHQ30は紙版 | 4回目 ・回答リンク ・GHQ30は紙版 | 5回目 ・回答リンク ・回答リンク2 (usability) ・GHQ30は紙版 |

*実験終了日は,3/14(金)になるため実験室(E-151)に返却できない方は,GHQ30と合わせて文京学院大学ふじみ野キャンパスの長野先生宛に郵送でお願いします.なお,郵送費につきましては実験者が負担します.その際,Paypayまたは銀行口座の振り込みなどで対応いたします.新学期の返却も可です.

4. 健康アプリの使用方法と,各指標の説明

健康アプリ・各種指標の説明については,下記のインストラクション動画にてご確認いただけます.健康アドバイスは,「解釈ボタン」を押さないとAIがグラフを参照できないので注意してください.健康アプリの起動は,webブラウザのChromeを推奨してます(FireFoxも可).それ以外のSafari, Edgeは使用できない可能性があるので注意してください.

*第10世代のiPad,第1世代のiPadProは動作確認済みですがそれ以外の端末は不明なため,PCで起動することを推奨します.画面の表示サイズは,「ctrl+マウスホイール」「ctrl+0(ゼロ)」で調整できます.

5. アプリ使用上の注意点

(1). 健康アプリ内で,データが表示されない場合,Fitbitアプリとの同期が行われていない可能性があります。また,午前7時と午後12時に,健康アプリ内のグラフデータが更新されます.Fitbitアプリと同期しても,リアルタイムで反映されないのでご注意ください.

(2). Fitbitアプリとデバイスの同期がうまくいかない場合は,通信環境が不安定な状況や,Fitbitデバイスの充電残量の不足が考えられるため,そちらを優先的にご確認ください.

(3). 健康アプリが正常に動作しない場合は,アプリの再起動や,Webブラウザの変更(Chrome→FireFox)をお試しください.問題が解消されない場合は,実験者にご連絡ください.

2要因参加者間計画の分散分析

2要因参加者間計画の分散分析

本ブログでは,仮想データをもとに2要因参加者間計画の分散分析について紹介いたします。具体的には,運動習慣と年齢層が自尊感情に及ぼす影響について検討します。詳細は,下記の3本の動画で説明しているので,ご確認ください。

1. 分析方法の解説

ここでは,js-starを用いた分析方法と,分析に用いた仮想データの詳細を説明しております。補足として,2要因分散分析についても簡単に紹介しております。

2. 分析結果の解釈

js-starで分析して得られた結果の解釈方法をこちらで説明しております。今回が初めて2要因の分散分析を扱う方もいらっしゃると思うので,下位検定についても詳しく説明しているため,動画の尺が少し長めです。

3. 結果の記述方法

レポート結果部分の記述方法を紹介しております。動画内で紹介したWordなどのファイルは下記に添付したので,必要に応じて使用してください。

その他

2要因分散分析の参加者内計画,および混合計画については,下記に添付したリンクから視聴可能です。その他,ご不明点があればTAにお申し付けください。

修論進捗_241218

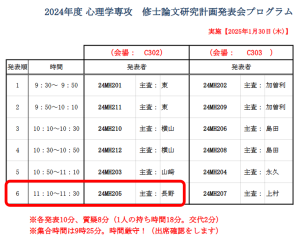

1. 修論計画発表日の確認

・1月30日(木):11:10~30,C302教室

・発表時間10分,質疑8分,交代2分

・現在,概要書とプレゼン資料を作成中

2.アプリ開発

・アドバイザー:シーンの切り替えを行えるようにした。軍人も導入可能

・ログイン画面:前回入力したIDを参照して入力候補出せるようにした

・デバックの表示:GPT2VVOXを改造して,デバックを表示するようにした

・日付の読み取り:グラフの月日の読み取りが弱くプロンプトで強化した

・その他:カメラ,食事アドバイス機能を消した

3. インストーラーの作成

・WindowsBuild:3分程度でビルド終了(656KB)

・配布ファイルの確認:以下の5つでしょうか,もしくは全部?

・dynabookで動作確認:ラグなどはなく,スムーズに動作していた

→シーンの切り替えが重い印象だった

4. 現状の問題点→解決!

・キャラクタが呼吸をするたびに,徐々に画面端に移動してしまう

→アニメーションのRootにチェックが入っているのが問題。徐々に制位置に戻らなくなってしまうため,チェックを外す。

・キャラクタの視線:Rook~のプログラムを入れる

=======================================================

FB

・土日の値:青・赤色で表示する→曜日がわかりにくいからPythonで変更

・今日の値が表示されていない→元に戻す(これもPython)

・ストレだけでなく、病気も考慮する→アドバイスのプロンプトの話

・環境音を付ける→アドバイザーのゲーム画面

・軍人の背景を整える→無駄な木が多い

・過去データの閲覧も不要→2週間表示してるから,インターフェイスが多い…

修論進捗_241211

1. BF投稿論文1

・査読コメントを修正して提出

・再審査で,結果は1か月後になります

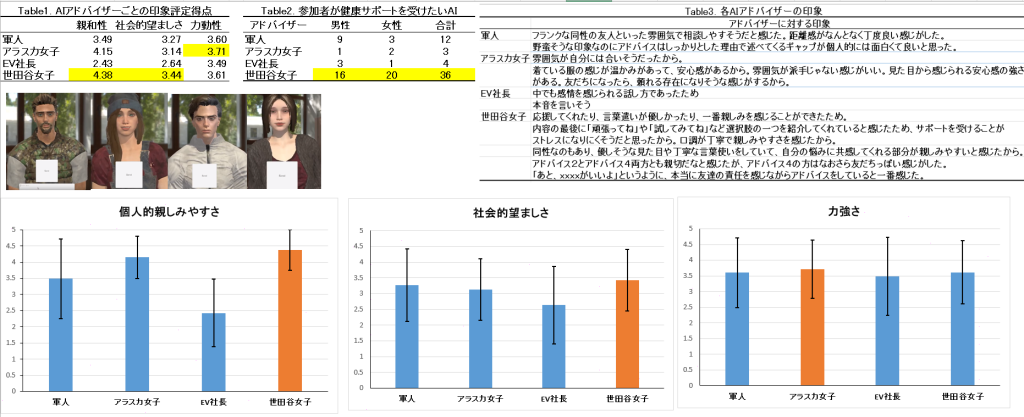

2. 予備調査の結果(N=56,男性30名,女性26名)

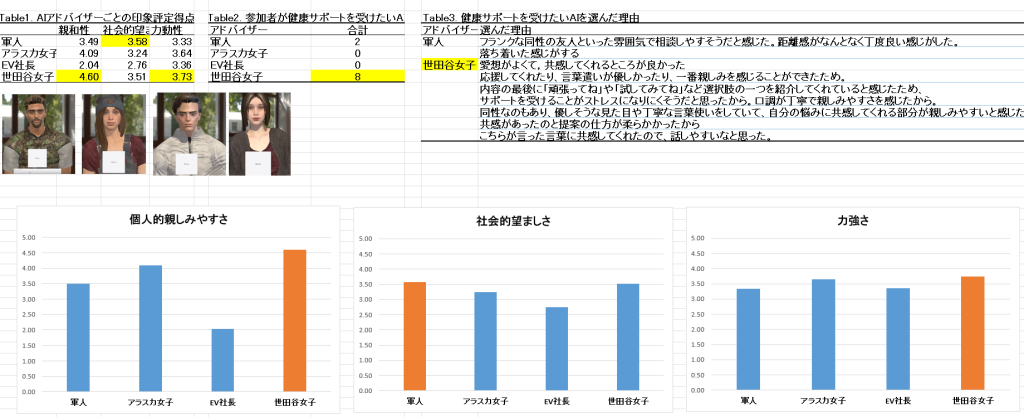

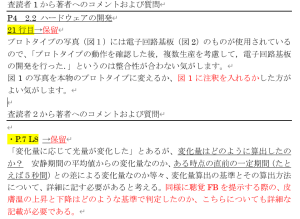

・親和性因子で最も得点が高く,サポートを受けたいと感じたAIは ”世田谷女子”

・印象評価の性差:男女ともに,「世田谷女子」を選択していた

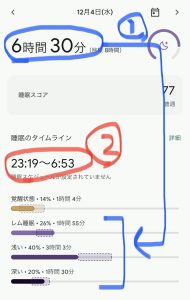

3. Fitbit-睡眠時間の取得問題が解決!

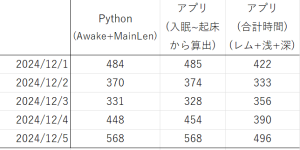

Fitbitアプリ・Pythonから取得したデータに,30分程度の誤差があった。Pythonのプログラムには問題はなかったため,アプリをみると…

・アプリの算出(①参照):覚醒状態を除く「レム睡眠+浅い睡眠+深い睡眠」

・Pythonの算出(②参照):「起きている時間(Awake)+寝ている時間(MainLen)」

12/1~12/5までのデータ内で,3~6分の誤差はあるものの大幅なズレはみられなくなった。これで,4指標のデータがほぼ正確に取得できることが確認された。

4. アプリ開発の進捗

・グラフの変更:PythonのRGBAから折れ線の色合いを薄くした

・瞬きと口パク機能が復元:BlinkCurveの作成、Lipsyncの設定を行った

・キャラクタ:肌の色と目の色を明るくして雰囲気を良くした,CharaChange追加

・シーンの切り替え:軍人と世田谷女子の2人を使えるようにした

=======================================================

アプリ開発についてのFB

・ID打つのは参加者からしたら面倒だから,入力履歴を残す設定を加える

・軍人も使えるようにする:プロンプトを整える

・Windows版のインストーラーを作る

→.exeをしょっぱいPCで動作チェックする(ウイルスの危険がないかもチェック)

・WebGLは無理…→そもそも画像を表示する開発が済んでいない

・食事もまた夢…→できそうにないかも…

・健康のアドバイス文→月日の読み取りが弱いため修正

・アプリ機能を減らす:写真撮影・食事の機能を消す

→写真撮影機能で,実験2では参加者の主観的な気分と,表情の非接触で推定するのも面白そう

学部4年生・M2が卒業するまでに,実験1のデータ収集をしておきたい。参加者内計画で,13名のデータが取れれば大分デカい。Forms作成とアプリ開発を早く進めないとだ。実験スケジュールを考慮すると,1月中旬までに始めないとやばいな…

修論進捗_241204

BF投稿論文_査読コメント修正

・査読および先生からいただいたコメントをもとに修正しました

・また,BF学会に再投稿いたしました

健康アドバイスアプリのアップデート

・fitbitデータのグラフを修正:日本語フォント使用,フォントサイズの変更等

・アドバイザー追加:予備調査を行っている途中だが,19/24人が世田谷女子を選択しているため,女性アドバイザーをも追加した

============================================================

予備調査(現在N=26)

現在,サイエンス基礎・生理心理学実験・神経生理心理学・ゼミ生(4年)を対象に予備調査の協力を依頼しています。順調に進めば,来週の進捗報告でN=80の調査結果を報告できそうです。

回答者

・サイエンス基礎:2人

・生理実験:11人

・授業外:13人

VRリモコンでのSceneの切り替え方

卒論 横須賀20241129発表

Quest2または、Quest3(ここではQuest2ということにしますが手順は同じです)のAボタンやBボタンでUnityのSceneを切り替える方法をわかりやすく説明します。以下の手順で進めてみてください。

1. 必要なパッケージをインストールする

Oculus Quest 2でボタン操作を認識するには、UnityにOculus IntegrationやXR Interaction Toolkitが必要です。

手順

- Unity Hubでプロジェクトを作成

・テンプレートを「3D」か「URP」に設定してください。 - Oculus Integrationをインポート

・UnityのAsset Storeで「Oculus Integration」を検索し、インポートします。 - XR Interaction Toolkitをインポート

・Unity Package Managerを開き、「XR Interaction Toolkit」をインポートします。 ・プロジェクト設定で「XR Plugin Management」を有効化し、Oculusを選択します。

XR Interaction ToolkitはUnityの公式パッケージで、Unity Package Managerから簡単にインストールできます。以下の手順で確認してください。

Unity Package Managerを開く

- Unityの上部メニューから**「Window > Package Manager」**をクリックします。

パッケージを表示する設定を変更

- 左上のプルダウンメニューで**「Unity Registry」**を選択します。

- デフォルトでは「In Project」になっているため、Unityが提供しているすべてのパッケージを表示するための変更です。

「XR Interaction Toolkit」を検索

- 検索バーに**「XR Interaction Toolkit」**と入力します。

- パッケージがリストに表示されます。

インストールする

- 「XR Interaction Toolkit」を選択し、右下の**「Install」**ボタンをクリックします。

サポートライブラリのインストール

インストール中に「Input Systemを使用するかどうか」のポップアップが出た場合は、**「Yes」**を選んでプロジェクトを再起動してください。

これで「XR Interaction Toolkit」がインストールされ、Oculus Quest 2の操作やインタラクション機能が利用できるようになります。

2. Oculusのボタン入力を取得する準備をする

Oculusのボタン入力は、UnityのOVRinputクラスを使って取得します。

手順

- Oculus Interaction Prefabをシーンに配置する

・OVRCameraRig をシーンにドラッグ&ドロップします。 - スクリプトを作成する

次のスクリプトを作成してScene切り替えの処理を実装します。

3. スクリプトを実装する

以下の手順でスクリプトを設定してください。

- スクリプトを作成する Unityの

Assetsフォルダで右クリックして「Create > C# Script」を選択し、スクリプト名を「SceneSwitcher」にします。 - コードを記述する 次のコードをスクリプトに貼り付けます。

using UnityEngine;

using UnityEngine.SceneManagement; // シーン管理用

public class SceneSwitcher : MonoBehaviour

{

void Update()

{

// AボタンでScene1に切り替え

if (OVRInput.GetDown(OVRInput.Button.One))

{

SceneManager.LoadScene(“Scene1”);

}

// BボタンでScene2に切り替え if (OVRInput.GetDown(OVRInput.Button.Two)) { SceneManager.LoadScene(“Scene2”); } } }

- スクリプトを適用する 作成したスクリプトを任意のオブジェクト(例えば

OVRCameraRig)にドラッグ&ドロップしてアタッチします。

4. Sceneを準備する

Unityで切り替えたいシーンを作成し、それぞれ名前を「Scene1」「Scene2」とします。

Unityの「File > Build Settings」を開く。

「Scenes In Build」に切り替えたいシーンを追加します。Scene1を先に追加し、次にScene2を追加します。

5. ビルドしてQuest 2でテスト

「File > Build Settings」からプラットフォームを「Android」に変更し、Quest 2に適したビルド設定を行います。

ビルドしてQuest 2にインストール。

実機でAボタンとBボタンを押してSceneが切り替わるか確認します。

これで、Quest 2のAボタンやBボタンを使ってシーンを切り替える仕組みが完成です。

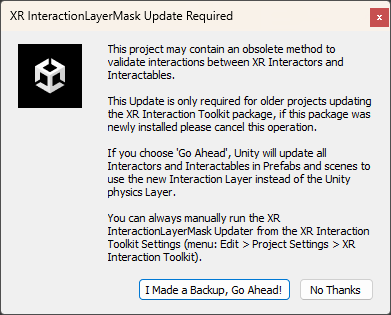

以下はXR Interaction Toolkitをインストールした際にでる忠告とその説明。

このメッセージは、XR Interaction Toolkitをインストールまたはアップデートした際に出る通知です。この通知は、古いプロジェクトや設定が新しいInteraction Layer Maskに適合するように変更されることを伝えています。このような表示が出た場合、以前からこのプロジェクトを使っていてXR Interaction Toolkitをアップデートした場合は、「I Made a Backup, Go Ahead!」を選んで設定を更新してください。これに当てはまらない場合は「No Thanks」で大丈夫です。

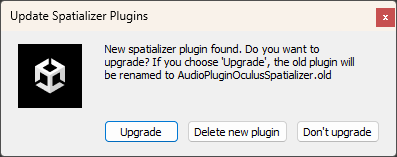

このメッセージは、Spatializer Pluginのアップグレードが完了したため、Unityエディターを再起動して更新を反映させる必要があることを示しています。

作業中の内容を保存している場合:

「Restart」をクリックしてUnityエディターを再起動してください。

作業中の内容をまだ保存していない場合:

「Not Now」を選んでプロジェクトを保存してから、手動でUnityエディターを再起動してください。

おしまい

修論進捗_241126

1. AIアドバイザーの印象評定結果_N=10(男性=6名,女性=4名)

前回,AIアドバイザーに対する特性推論を行ったが,どの因子を持って評定値が高かったか解釈が困難だったため,親和性因子を含めた林(1978)の印象評定尺度をもとに,再度調査を行った。

・林(1978):印象評定尺度

世田谷女子が,親和性・力動性の尺度得点が最も高かった。また,独自項目として,サポートされたいAIは?という質問においても,やはり世田谷女子が高く,「共感してくれる,親しみやすい,言葉遣いが丁寧」という理由が挙げられた。

・特性推論:アメリカ大学生に行った調査では,外向性が高い人は内向性の高い人と比べ,近づきやすく幸福感を感じやすいと報告されている(大石)。日本とドイツは,文化差(幼少期の人との関り)からあまり変わらないと言われている。

2. 投稿論文1のコメント修正

査読者のコメントを基に論文を修正いたしました。修正後の文章の確認をよろしくお願いいたします。

修論進捗_241120

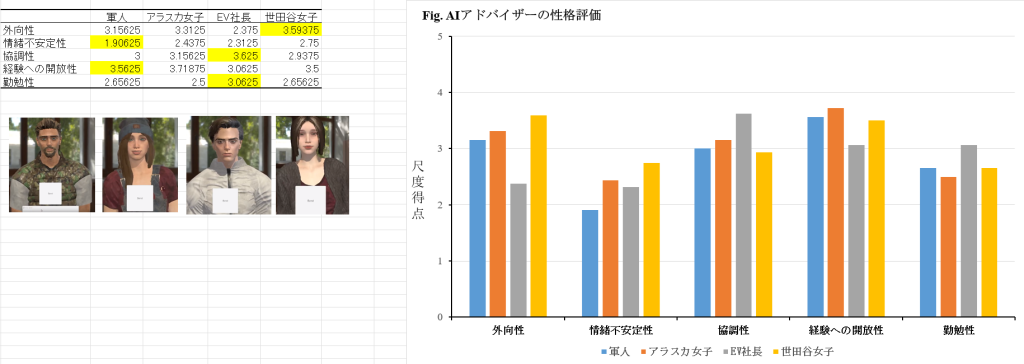

1. AIアドバイザーの印象評定の結果

橋本・古谷(2019)のBig5特性推論を用いて,7名(男性4, 女性3名)を対象に行った。結果として,「1位:世田谷女子,2位:アラスカ女子」の順で評価された。AIに質問した内容と,結果のグラフは下記の通りです。実験刺激の動画は,こちらです。

AIアドバイザーに質問した内容

1. 「食べ過ぎを防ぐにはどうすればいいか?」

2. 「屋内でできる効果的な運動は?」

3. 「睡眠の質を改善するためにできることは?」

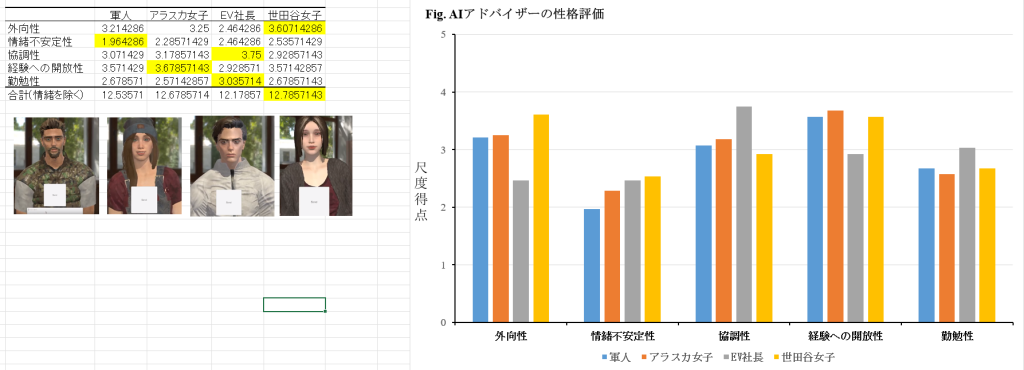

2. 食事の評価方法

食事が改善されたかについての評価は,健康長寿医療センターの食事バランスチェックシート,もしくは内海他(2015)の食行動尺度を使用する。26点以上で栄養バランスが保たれている可能性が高いとされる。また,phpの食事画像の送信画面に,「食事日記(食べたものや感想をメモ,満足感・満腹感)」,「食行動の改善を評価(野菜を意識している,外食を控える」の項目を追加する。

・内海他(2015)の食行動尺度:食事バランス,食行動のアセスメントが行える

3. BF投稿論文2

・お時間のある際に、BF論文の修正をお願いいたします。

=====================================================

先生からのコメント

・AIからのアドバイスが渋い。知識は十分なため,強調してほしいとこを絞る

・FBが多すぎるため,まずは睡眠と運動に絞る。次の研究で食事を取り入れる

・FitbitMaxが偶に落ちてデータが取れていない日がある。プログラムから取得できていない日があれば,後からまとめて取得できるようにする処理を加える

・睡眠の主観評定を取り入れる(小川さんの卒論・先生のFitbit研究を参照)

・実験スケジュールが長くて脱落者が出るため,2週間ペースで行い,フォローアップ期間を設けるのが理想。

・予備実験の準備に移る。取り合えず,WindowsPCに直接Buildして行ってもらう

・予備調査では,性格5因子だと結局何がいいのかわからないため,親しみ・力強さ・~の3因子の印象評定の尺度を使用する。